Letzte Woche kamen ChatGPT-5.1 und Gemini-3.0 heraus, die man theoretisch beide für ähnliche Aufgaben und mit vergleichbarer Art nutzen/prompten kann - aber wenn man etwas fortgeschrittener ist, merkt man Unterschiede. Die zeige ich hiermit auf.

Inhaltsverzeichnis

1. Das verstehen KI Modelle unter “niedlich”.

Bevor ich in den Sprachmodell-Vergleich gehe, ein kurzes Wort zu meinem Newsletter-Header, den ich jede Woche neu erstelle und nur in der Internet-Version angezeigt wird. Im E-Mail-Programm erscheint immer dasselbe Kardashev-Bild, um beim hektischen Posteingang scannen Wiedererkennung zu gewährleisten.

Darum denke ich mir jede Woche eine Bild-Idee aus, die zum Inhalt passt. Diesmal wollte ich 2 niedliche KI-Roboter beim Armwrestling zeigen (= ChatGPT + Gemini).

Der hat mir diesen Prompt erstellt:

Cosmic Cantina Tech — adorable arm-wrestling scene on a holographic table. Two cute AI robots, no human likeness:

Robot A (ChatGPT-5.1 vibes): rounded plush-metal head like a soft capsule; expressive LED eyes, tiny chevron mouth; teal neural halo with flowing token-style glyphs. Body: fully robotic deep-charcoal chassis with ChatGPT teal #10A37F and cosmic teal #00F2EA accents, micro-panels, glowing seams, worn edges.

Robot B (Gemini 3.0 vibes): faceted prism head split into two gentle orb-lobes (twin motif), star-pupil eyes; gradient #3C00FF→#00D4FF with pops of solar yellow #FFEB3B. Body: sleek chrome with prismatic light strips, articulated servos, soft glow ports.

Setting: lively space bar; friendly bio-mech “AI guide” patrons; floating data streams, tiny camera drones.

Background: deep space base #100C14, neon bursts #FF00A8/#00F2EA/#FFEB3B, nebulae and planet silhouettes in portholes.

Look & camera: polished cinematic 3D, low-angle medium-wide (~35mm), shallow DOF; crisp rim lights, volumetric rays, ray-traced reflections, subtle bokeh, soft bloom.

UI: holographic scoreboard “ChatGPT-5.1 vs Gemini 3.0” (no logos).

Composition: rule of thirds, bold silhouettes, dynamic diagonals; clear faces/hands for thumbnail readability.

Typography space: clean top-left for “KARDASHEV-CAMPUS” (sci-fi sans like Audiowide/Rajdhani). Ultra-detailed, joyful, premium, 8k, aspect ratio 16:9.

Warum sind die Bilder alle leicht anders?

Das liegt u.a. an unterschiedlichen Trainingsdaten (bei Bild-KI sind das die Bilder) und wie die Hersteller sie programmiert und konfiguriert haben.

Zudem ist KI probabalistisch. Das bedeutet:

EXPERTE:

Ein probabilistisches KI-Modell repräsentiert Unsicherheit explizit über Wahrscheinlichkeitsverteilungen und leitet Vorhersagen/Entscheidungen aus berechneten Likelihoods oder Posteriors statt festen Regeln ab.

MASTERSTUDI:

Solche Modelle behandeln Daten und Parameter als Zufallsvariablen, nutzen Statistik (z. B. Bayes’sche Inferenz) und liefern kalibrierte Wahrscheinlichkeiten statt nur Ja/Nein-Antworten. Das Ergebnis kann zwischen Runs variieren (Sampling), ist aber begründet durch die zugrunde liegende Verteilung. So wird Rauschen, Mehrdeutigkeit und Datenknappheit sauber erfasst.

BACHELOR:

Statt „Es ist eine Katze.“ sagt die KI „Mit 82 % Wahrscheinlichkeit ist es eine Katze.“; sie rechnet also mit Chancen. Darum können Antworten je nach Zufallssampling leicht unterschiedlich sein. Das ist nützlich, wenn die Daten unsicher oder mehrdeutig sind.

TEEN:

Probabilistisch heißt: Die KI schätzt die Chancen und sagt, wie sicher sie ist. Deshalb kann sie beim selben Prompt manchmal leicht anders antworten. Es ist kein „Würfeln“, sondern gerechnete Unsicherheit.

Darum produtziert selbst ein und dieselbe KI mit selbem Prompt unterschiedliche Outputs – egal ob Bild, Video, Musik oder Text…

2. Allgemeines zu Sprachmodellen (LLMs)

Ich benutze je nach Arbeitsziel für einen Output bis zu 7 Sprachmodelle, d.h. ich erstelle erst einen sehr genauen Prompt und kopiere ihn dann in mehrere rein. IMHO ist das wie in einer Firma, wenn man eine Aufgabe hat und sie 7 Menschen gibt, die alle leicht unterschiedlich arbeiten und andere Stärken + Schwächen haben.

Zudem ändern sich meine Präferenzen regelmäßig, weil alle Modelle (von Text zu Bild zu Video) sich permanent weiterentwickeln. Lange Zeit war z.B. Claude mein Favorit. Bevor es offiziell in Deutschland erhältlich war oder überhaupt jemand kannte, hatte ich es via Registrierung mit US-Handynummer + Hongkonger Konto genutzt und geliebt, weil es den besten Denk-, Kreativ- und Text-Output lieferte. BY FAR!

Das war von Version 1 bis 3.5. Leider hat Anthropic ab 3.7 ihr LLM mehr Richtung Programmierung getunt und fokussiert sich auf B2B Markt, während OpenAI auf B2C fokussiert – und aktuell wieder “smarter” ist.

Darum bevorzuge ich aktuell ChatGPT, Gemini und andere LLMs – je nach Use-Case. Besonders bei deutscher Sprache muss man grammatikalisch und stilistisch schleifen, d.h. Texte schön zurren. Nie 1:1 kopieren, weil einerseits die meisten Trainingstexte auf Englisch und zudem die meisten Hersteller US-Firmen sind.

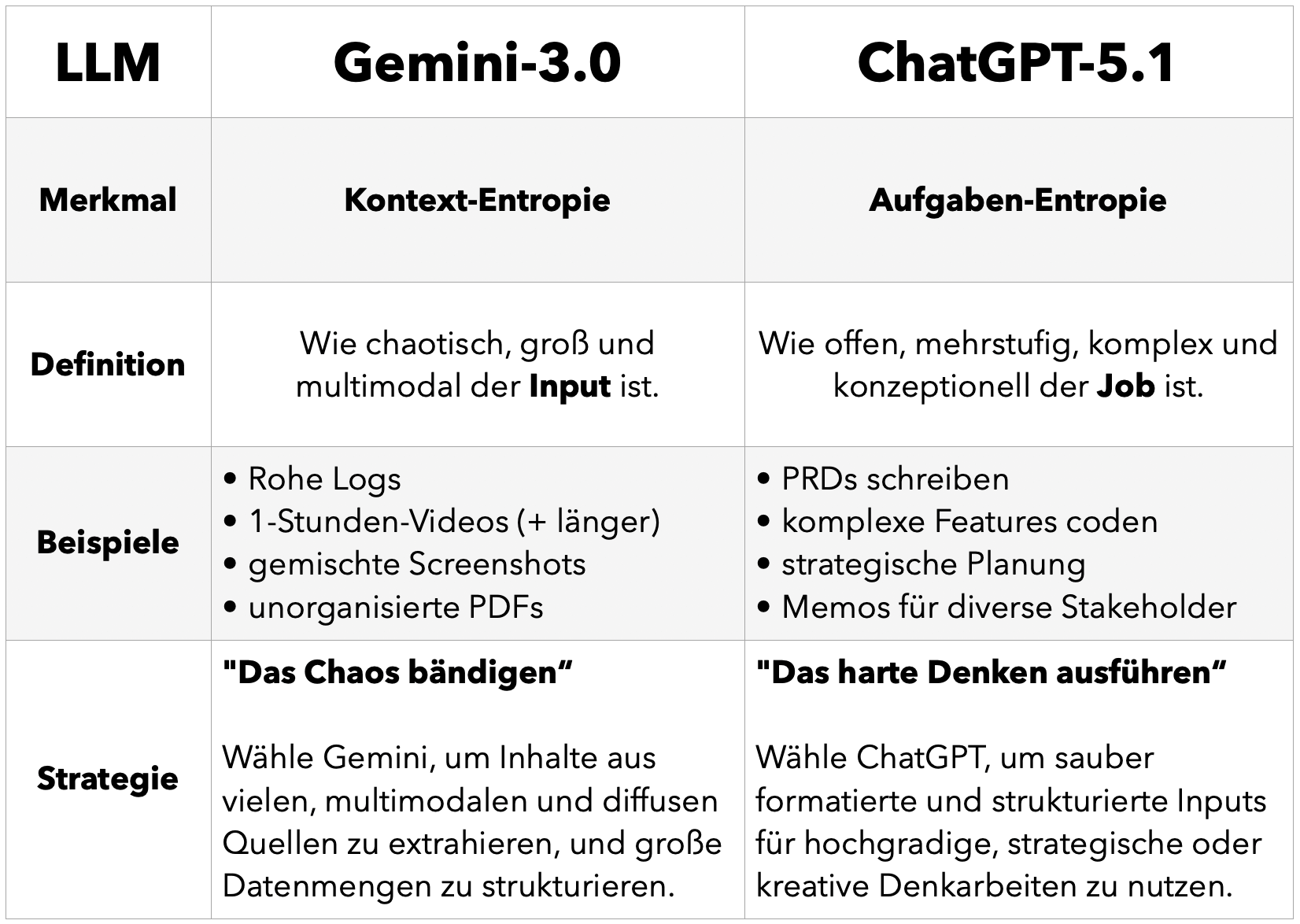

3. Wann Gemini-3.0 oder ChatGPT-5.1?

Gemini 3 ist dafür gebaut, Kontext-Entropie zu verarbeiten (chaotische, multimodale Inputs mit hohem Volumen).

ChatGPT 5.1 ist dafür gebaut, Aufgaben-Entropie zu bewältigen (komplexe, mehrstufige Schlussfolgerungen und Ausführung auf sauberen Daten).

4. Gemini-3.0 ist der Entropie-Fresser

Mentales Modell:

Das "Gehirn im Glas" für das Chaos. Sein Vorteil ist die Multimodalität – es behandelt Videos, Bilder und massive Text-Logs als Objekte erster Klasse.

BEIBEHALTEN (Keep)

Präzision: Sei eindeutig bei Zielen und Ausgabeformaten.

Strukturierter Output: Frage weiterhin nach JSON, Tabellen und standardisierten Tags.

Schrittweise Logik: Nutze Step-by-Step-Anweisungen für komplizierte Aufgaben.

VERMEIDEN (Stop)

Behandlung wie ChatGPT: Sende nicht nur kurze Text-Prompts. Du verschenkst den multimodalen Vorteil.

Anweisungen am Anfang (Top-Loading): Bei massiven Kontext-Fenstern (1M+ Token) gehören die Anweisungen nicht nach oben. Kontext zuerst, Anweisungen ganz nach unten.

Geschwätzigkeit erwarten: Gemini 3 ist auf Kürze getrimmt. Wenn du einen narrativen Text willst, musst du Länge/Detailgrad explizit anfordern.

Vage Referenzen: Hör auf zu sagen: "Siehe Screenshot oben."

BEGINNEN (Start)

"Messy Bundles" füttern: Gib ihm die rohen Logs, das einstündige Video, den PDF-Dump. Es ist exzellent darin, Signale im Rauschen zu finden.

Anchoring Prompts: Platziere Anweisungen am Ende mit der Phrase: "Basierend auf den Informationen oben, mache X..."

Benennung & Indexierung von Modalitäten: Sei spezifisch bei den Inputs.

Schlecht: "Schau dir das Bild an."

Gut: "Nutze Bild 1 (Funnel Dashboard) für X. Nutze Video 2 (Zeitstempel 1:30-2:00) für Y."

Reasoning-Kontrollen: Erhöhe das "Thinking Level" nur, wenn du eine dokumentenübergreifende Synthese benötigst. Halte es niedrig für einfache Extraktion/Labeling.

5. ChatGPT-5.1 ist der Operator & Denker

Mentales Modell:

Betrachte 5.1 als spezialisierten Operator, Business-Writer oder Coder. Es ist darauf optimiert, Anweisungen strikt zu befolgen und komplexe Aufgaben auf kuratierten Daten auszuführen.

BEIBEHALTEN (Keep)

Rolle/Zielgruppe/Ton: Definiere diese weiterhin explizit. 5.1 benötigt dies, um den Sprachstil festzulegen.

Explizite Struktur: Verlange spezifische Outputs (Abschnitte, Überschriften, Anzahl der Stichpunkte, JSON-Schemata). 5.1 hält sich sehr zuverlässig an strukturelle Vorgaben.

Modus-Wechsel: Nutze "Instant" für leichte Bearbeitungen/schnelle Antworten; nutze "Thinking" für Refactoring und harte Logik. Lass das Modell die Führung übernehmen.

VERMEIDEN (Stop)

Context Dumping: Kippe keine riesigen, ungefilterten Kontext-Fenster (Logs, rohe PDFs) hinein. Es verwässert den Wert des Modells und erhöht die Kosten.

Die Aufgabe verstecken: Vergrabe die eigentliche Anweisung nicht in einer "Wand aus Hintergrundinformationen" oder Firmen-Lore.

Task Packing: Hör auf, 4-5 verschiedene Jobs (z.B. Ideenfindung + Kritik + Auswahl) in einen Prompt zu packen. Unterteile sie in verkettete Schritte.

BEGINNEN (Start)

Interne Funktionsbibliothek: Definiere wiederverwendbare Muster/Formate (z.B. "Standard Internes Memo Format") in den Systemanweisungen und rufe sie später namentlich ab.

Schritt-Pläne für das Denken: Erzwinge bewusstes Nachdenken durch Prozessvorgaben: "Stelle zuerst 3 klärende Fragen, schlage dann 3 Optionen vor, schreibe dann das Dokument."

Tool-Constraints: Sage dem Modell explizit, welche Tools wichtig sind (z.B. "Websuche ist für diesen Schritt kritisch").

Register-Constraints: Begrenze die Ausführlichkeit, um die Qualität zu steuern (z.B. "Muss 5-7 Stichpunkte für ein VP-Publikum umfassen").

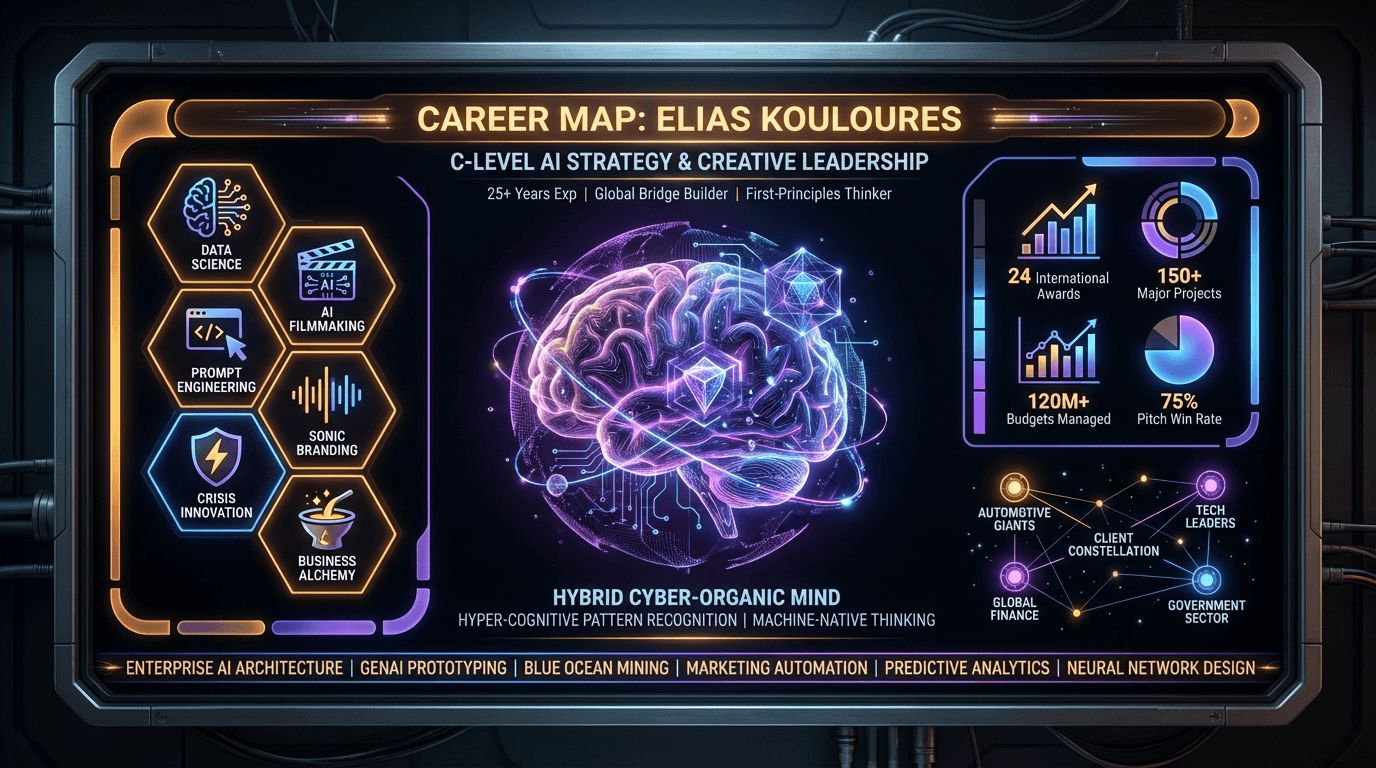

6. So habt Ihr Spaß mit eurem Lebenslauf

Google hat letzte Woche fast ein Dutzend Updates gelauncht. Neben Gemini 3.0 u.a. auch NanoBanana Pro. Das ist eine Bild-KI, die in der 1. Version “nur” gut in Bild-Editierung war. Aber jetzt mit 2. Version (bzw. Pro) auch unglaublich gut in Bilderstellung, wie folgende Motive beweisen.

Probiert das für euch aus:

Ladet euer LinkedIn-Profil als PDF herunter.

Dann zu NanoBanana hochladen.

Prompt: “Erstelle mir eine Career Map in Design von XYZ mit thematisch passenden Visualisierungen.“

Ich habe Star Trek Display gewählt. #Logisch Das geht aber mit allen, z.B. Herr der Ringe Landkarte, uvm. Ihr müsst euren Wunsch nur eindeutig und unmissverständlich ausdrücken bzw. formulieren.

Tipp für alle ohne LinkedIn-Profil:

Einfach Lebenslauf in Google Gemini-3.0 hochladen und bitten, dass es die Infos in NanoBanana Prompt umwandelt – in dem Look, den Ihr wünscht.

Bei mir kommt dann so ein Prompt heraus:

A hyper-realistic 4K Sci-Fi command center display interface titled "CAREER MAP: ELIAS KOULOURES".

VISUAL STYLE:

Futuristic 24th-century retro-future aesthetic. Deep black background with rounded, illuminated UI bars in Amber, Galaxy-Purple, and Federation-Blue. Layout is asymmetric, data-dense, and sharp.

CENTER FOCUS:

A glowing 3D visualization of a "Hybrid Cyber-Organic Mind"—organic neural synapses merging with digital AI nodes. Represents "Hyper-Cognitive Pattern Recognition" combined with "Machine-Native Thinking."

SURROUNDING MODULES:

[1] HEADER SECTION: Text "C-LEVEL AI STRATEGY & CREATIVE LEADERSHIP". Subtext: "25+ Years Exp" | "Global Bridge Builder" | "First-Principles Thinker".

[2] SKILLS MATRIX (Left Panel): Hex-grid displaying icons for: "Data Science", "AI Filmmaking", "Prompt Engineering", "Sonic Branding", "Crisis Innovation", "Business Alchemy".

[3] ACHIEVEMENT METRICS (Right Panel): Bar graphs and charts visualization:

"24 International Awards"

"150+ Major Projects"

"120M+ Budgets Managed"

"75% Pitch Win Rate"

[4] STRATEGIC OUTPUT (Bottom Banner): Scrolling data stream: "Enterprise AI Architecture", "GenAI Prototyping", "Blue Ocean Mining", "Marketing Automation".

[5] CLIENT CONSTELLATION: A star map connecting nodes labeled: AUTOMOTIVE GIANTS, TECH LEADERS, GLOBAL FINANCE, GOVERNMENT SECTOR.

Look: Cinematic lighting, high-tech infographic, 8K resolution, highly detailed text rendering, professional data visualization.

Gutes Beispiel für einen “KI-Fehler”:

KI-Modelle sind alle probabalistisch, d.h. Sie erstellen nie 100% reproduzierbar genau dasselbe. Beim 2. Versuch hatte ich “Prompt-Optimierung” von NanoBanana aktivierunt und die hat nicht nur mein Bildformat von 16:9 auf 1:1 verändert, sondern auch den Inhalt “leicht optimiert”. 🤪

Fun fact: Bei meinem 2. Versuch hat die KI dann ohne mein Zutun eine Timeline bis 2410 erstellt und ich hoffe, dass die KI mehr weiss als ich. Aber „Interstellar AI Governance Established“ passt in meinen Lebensplan 🤣

So werdet Ihr zu Zeitreisenden

Einfach Portrait zu NanoBanana hochladen und prompten:

“Make a 4×4 grid starting with the 1880s. In each section, I should appear styled according to that decade (clothing, hairstyle, facial hair, accessories). Use colors, background, & film style accordingly.”

Verrückteste neue KI-Möglichkeit unlocked!

Es gibt bei KI den Begriff “Emerging Properties”. Übersetzt könnte man von “aufkommenden/entstehenden Eigenschaften” sprechen. Das bedeutet, dass alle KIs, von Text zu Bild zu Video und mehr, plötzlich Dinge können, die keiner vorhergesehen hat, z.B. wie jetzt Google’s neues NanoBanana Bild-KI-Modelll, weil es mit dem Gemini Sprachmodell verschmolzen ist.

Was Ihr oben auf den 3 Bildern seht

Da kamen 3 Leute auf die Idee, um ein Bild/Foto zu bitten, die zu gewissen Zeitpunkten historische Orten zeigen: Jesus' Kreuzigung, JFK Autokorso am Tag seiner Ermordung und World Trade Center Unglück.

Weil die KI weiss, was an den Tagen und Orten passierte, und zudem Bilder erstellen kann, macht sie das bestmöglich. #CrazyNewTimes

Welches historische Ereignis promptet ihr? Taggt mich beim Posten! 😉

7. Mein Geburtstag

Heute ist mein Geburtstag. Ich werde irgendwas zwischen gefühlt 15 und 79 Jahren alt. Hängt von der Uhrzeit und Raumtemperatur ab.

Mein einziger Wunsch:

Bitte Newsletter an eine Person weiterleiten und zum Abonnieren animieren.

Danke 😉

Mein nächster Berliner KI-Workshop (gratis!)

Dort präsentiere ich den Inhalt vom unteren Video – mit vielen, neuen Updates und aktualisierten Tipps & Tricks – in normalem Tempo:

7.12. @ 14 – 17 Uhr

Dietrich-Bonhoeffer-Bibliothek in Brandenburgische Str. 2, 10713 Berlin.

Einfach vorbei kommen. Ohne Anmeldung. Tablet oder Laptop mitbringen empfohlen. Zur Not geht auch nur Smartphone oder zurücklehnen und nur zuhören. First come, first Sitzgelegenheit.

Ihnen gefällt mein Newsletter?

Danke. Freut mich, wenn Sie Freude daran haben. Ich freue mich zudem über jede Art der Unterstützung:

Teilen Sie Ihn gern mit Freunden, Bekannten und Lernwilligen.

Folgen Sie mir auf Ihren bevorzugten Social Media Plattformen.

Spenden Sie etwas Trinkgeld. Ein Euro hilft mir schon – und erleichtert mir Ihr Leben in Zukunft mit News, Tipps und mehr zu bereichern…