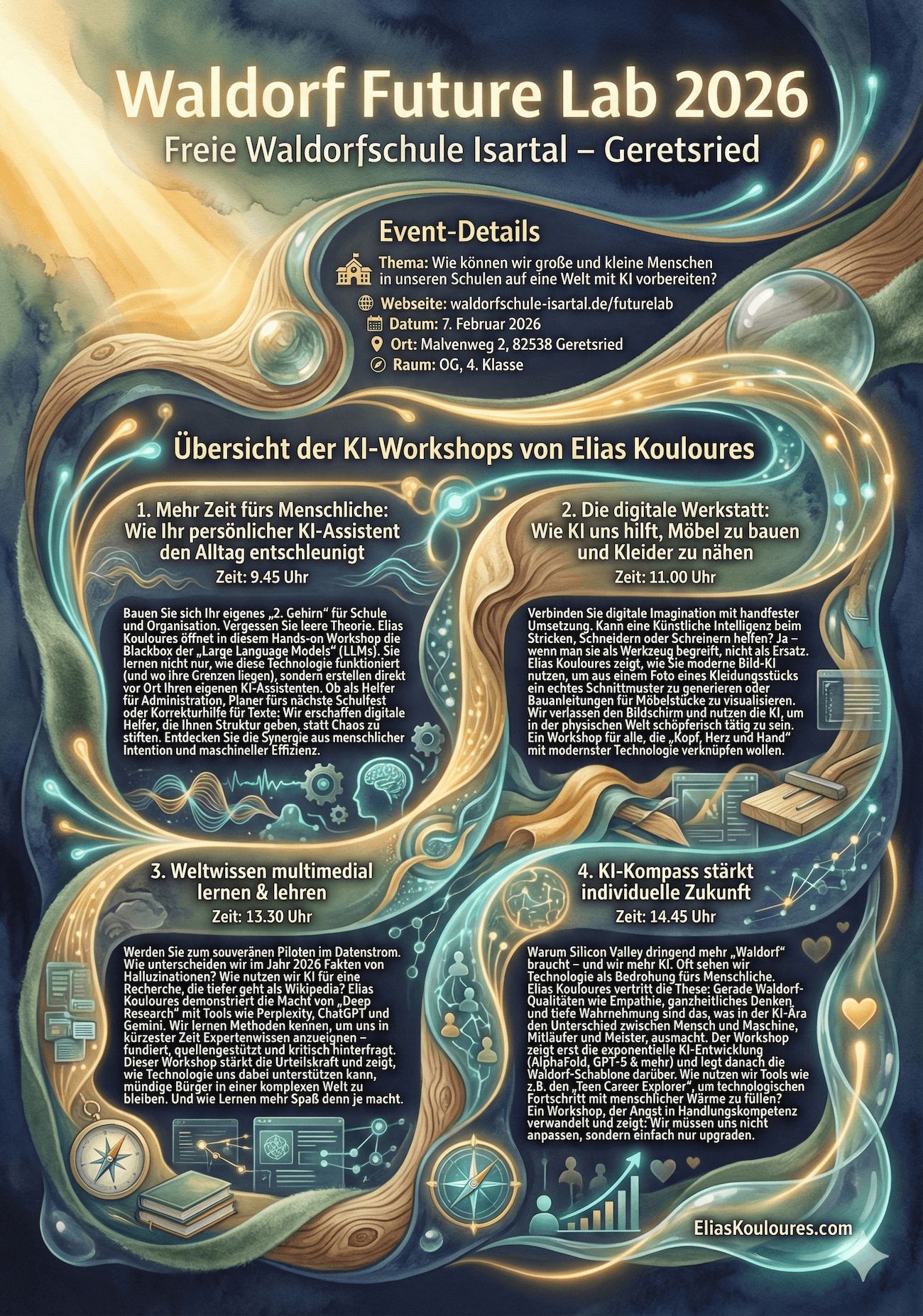

Letzte Chance sich fürs Waldorf Future Lab 2026 anzumelden und mich übernächsten (Samstag, den 7.2.) in München live in 4 KI-Workshops zu erleben, um mir bei und zwischen meinen KI-Kursen Löcher in den Bauch zu fragen. Klick hier!

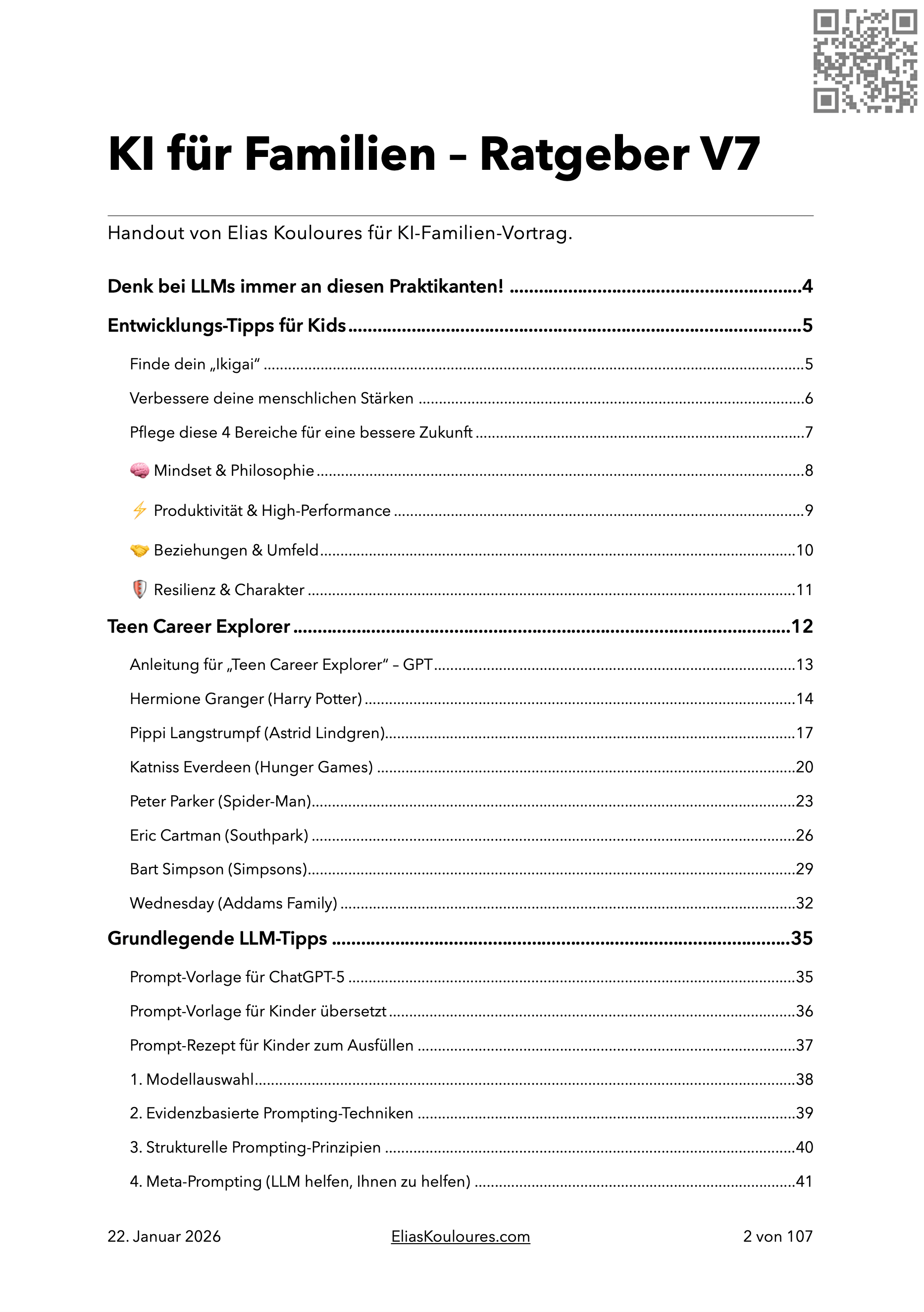

Inhaltsverzeichnis:

1. Neuer “KI für Familien” Ratgeber

Ich habe meinen “KI für Familien” Ratgeber überarbeitet.

Er ist in der 7. deutschen Version von 65 auf 107 DIN A4 Seiten gewachsen.

Einfach aufs Titel-Bild oben oder Inhaltsverzeichnis unten klicken, um PDF auf meinem Google Drive zu öffnen, und online anschauen oder gratis herunterladen.

Ich freue mich immer auf Feedback, was fehlt und wie ich ihn weiter verbessern kann. Einfach auf diesen Newsletter antworten, falls dir was einfällt.

2. So erklimmst du Karriereleiter schneller

Sitzfleisch und Abwarten sind sowas von 2025!

3. KI-Video Crash-Kurs für Anfänger

Tim ist einer meiner 3 Lieblings-YouTuber für KI-Bild- und -Video-Erstellung, d.h. ich empfehle jedem ihm zu folgen. Normalerweise präsentiert er mindestens 1x pro Woche die neuesten KI-Video-Updates, -Tools & -Tricks.

Diesmal hat er eine Art Crash-Kurs erstellt, wo er in paar Minuten die Geschichte von den ersten KI-Videos von 2015 bis heute 2026 aufzeigt – und bei den aktuell besten Modellen endet, inkl. kurzer Begründung mit Beispielen.

⚡ Executive Summary

Es gibt aktuell kein "perfektes" All-in-One-Modell. Der Industriestandard ist ein hybrider Workflow: Spezifische Tools für spezifische Aufgaben kombinieren (z.B. Google für Bildkonsistenz + Kling für Bewegung + Veo für Audio).

🛠 1. Kern-Methoden der Generierung

Methode | Funktionsweise | Anwendungsfall & Status |

Image-to-Video | Industrie-Standard. Ein Bild dient als "Frame 1". | Maximale Kontrolle über Ästhetik & Komposition. Ermöglicht Storyboarding vor der Animation. |

Text-to-Video | Klassisches Prompting. | Hohe Stabilität, aber schwer exakt zu steuern (Zufallsfaktor). |

Video-to-Video | Bestehendes Video wird umgestylt (Style Transfer). | Höchste Kontrolle über Bewegung/Timing. (Wachstumstrend für 2026). |

Reference-to-Video | Assets (Person + Ort + Objekt) definieren Output. | Hybrid aus Bild/Text. Gut für Charakter-Konsistenz. |

🎨 2. Toolkit: Bild-Generatoren (Die Basis)

Qualität des Videos hängt zu 100% vom Input-Bild ab.

🏆 Google "Nanobanana Pro" (Top-Empfehlung):

USP: Generiert und editiert Bilder. Extrem hohe Konsistenz bei Änderungen.

Workflow: Bild erstellen -> In Nanobanana expandieren/anpassen -> Als Start-Frame für Video nutzen.

Midjourney: Beste künstlerische Ästhetik, aber schwer kontrollierbar für konsistente Storyboards.

Flux v2 (Black Forest Labs): Fokus auf Fotorealismus, aktuell noch im Beta-Stadium (teils fehlerhaft).

🎥 3. Toolkit: Video-Modelle (Die Engine)

Wähle das Modell basierend auf dem primären Ziel.

Modell | Anbieter | Stärke | Schwäche/Notiz |

Veo 3.1 | Allrounder & Audio | Generiert Video inkl. Sound & Dialogen. | |

Kling 2.6 | Kuaishou | Motion (Bewegung) | Beste Physik/Bewegung. Audio vorhanden aber schwach. |

Sora 2 | OpenAI | Realismus & Audio | Top Audio-Qualität. Erzwingt Realismus (schlecht für stilisierte Charaktere). |

Gen 4.5 | Runway | Visuals | Sehr neu. Exzellente Bildqualität, noch kein Audio. |

Ray 3 | Luma Labs | Video-to-Video | Exzellent für das Umstylen von Footage. |

⌨️ 4. Prompting Strategien 2.0

A. Der LLM-Workflow (Conversational Prompting)

Schreibe Prompts nicht selbst.

Nutze ChatGPT, Gemini oder Claude: "Schreibe mir einen detaillierten Video-Prompt für [Szene], optimiert für [Modell-Name]."

Output prüfen -> In den Video-Generator kopieren.

B. JSON Prompting

Bitte das LLM um Output im JSON-Format.

🚀 5. Workflow-Tools & Aggregatoren

Vermeide 50 einzelne Abos.

Flora: (Empfehlung) Node-basierter Workflow. Erlaubt das Verknüpfen verschiedener Modelle in einer Pipeline.

Wispr Flow: Voice-to-Text Tool. Schnelleres Diktieren von Prompts/Ideen als Tippen.

FreePick: Aggregator. Bietet Zugriff auf viele Top-Modelle unter einer Oberfläche.

✅ 6. Actionable Advice (Sofortmaßnahmen)

Image-to-Video meistern: Das ist der wichtigste Skill. Lerne erst, perfekte Standbilder (Frames) zu erstellen, bevor du animierst.

Hybrid arbeiten: Nutze Nanobanana für das Bild, Kling für die Bewegung und Veo für den Ton.

Keine Angst vor Nodes: Tools wie Flora wirken komplex, bieten aber die nötige Skalierbarkeit für professionelle Ergebnisse.

Starten: Wir sind erst im Jahr 4 der Technologie. Der Einstieg ist jetzt noch früh genug ("Freshman Class").

Dir gefällt mein Newsletter?

Danke. Freut mich, wenn du Freude daran hast.

Ich freue mich über jede Art der Unterstützung:

Teile diesen Newsletter mit Freunden, Bekannten und Lernwilligen, damit Sie nicht vom Tempo der KI-Transformation abgehängt werden.

Folge mir auf deinen bevorzugten Social Media Plattformen, wo ich nur über KI, Technologien, Kreativität, Strategien und Fortbildung poste.