Kein KI-Newsletter – sondern Zukunfts-Ratgeber!

Ich rede gern und viel über KI, aber mein Fokus ist: Wie schaffen wir es möglichst sicher und schnell die Menschheit zu einer egalitären, gesunden und glücklichen interplanetaren Zivilisation upzugraden, die das Universum erforscht und mit anderen intelligenten Lebensformen Kontakt aufnimmt?!

Im Sinne von z.B. Star Trek oder einer Kardashew Zivilisation.

Darum poste ich heute nicht lustige KI-Weihnachtsbildchen, sondern versuche kurz, einfach, klar und unmissverständlich aufzuzeigen, wo die Menschheit steht und was uns in den nächsten Jahren bevorsteht.

Am Ende dieses Newsletters versteht hoffentlich jeder – besonders alle, die mein obiges Ziel als “verrückt” abstempeln – das die Menschheit kurz davor ist, was Jahrzehnte lang als Science-Fiction galt, Realität werden zu lassen.

Das gelingt aber nur, wenn wir richtiges, gutes und funktionales KI-Knowhow in allen Teilen unserer Bevölkerung verankern, weil wenn nicht, dann führen uns die wenigen Tech-Oligarchen mit diesem KI-Wissen. #FroheFeiertage

Inhaltsverzeichnis:

1. Das größte KI-Problem

Wir leben in einer Aufmerksamkeitsökonomie, wo leider zu viele zu jedem Thema ihren Senf dazu geben müssen – auch ohne einen Funken Ahnung.

Ich sehe das in immer mehr falschen KI-Artikeln, sogar von Tech-Magazinen, wo deren deutsche “Tech-Experten” offensichtlich nur 1:1 einen US-Artikel übersetzt (und verlinkt) haben, der auch schon falsch war. Als ich einem Author freundlich schrieb und seinen Fehler mit technischer Erklärung aufzeigte, kam nur ein “das ist deine Meinung” zurück, ohne überhaupt meinen sachlichen Hinweis zu beachten. Viele Menschen scheitern heute schon daran Meinungen von Fakten zu unterscheiden.

Ich habe es sogar am eigenen Leib erfahren, z.B. “KI-Redakteurin” vom Deutschlandradio 1,5 Stunden Interview gegeben, die nur 2-Min. Soundbyte rausschnnitt und von promoviertem Psychologen falsch kommentieren lies, der absolut keine Ahnung von KI hatte (aber laut seiner eigenen Webseite plötzlich KI-Experte ist), und meine Aussage (“LLMs sind gut in Mustererkennung und Analyse von vielfältigen Zusammenhängen, usw.”) als falsch und Unsinn abstempelte. Kurz darauf sah ich ihn auf der OMR (Online Marketing Rockstars) Vortrag halten, der von Fehlern strotzte. Aber alle Anwesenden klatschten – ohne auch nur einer kritischen Nachfrage! Ich möchte nicht wissen, wie oft sein Unsinn z.B. per YouTube Video geteilt wurde.

Das führt leider zu einem immer größeren BS-Tsunami, weil KI immer schneller immer besser – aber auch mannigfaltiger und komplexer – wird.

Woher kommen KI-Fehleinschätzungen?

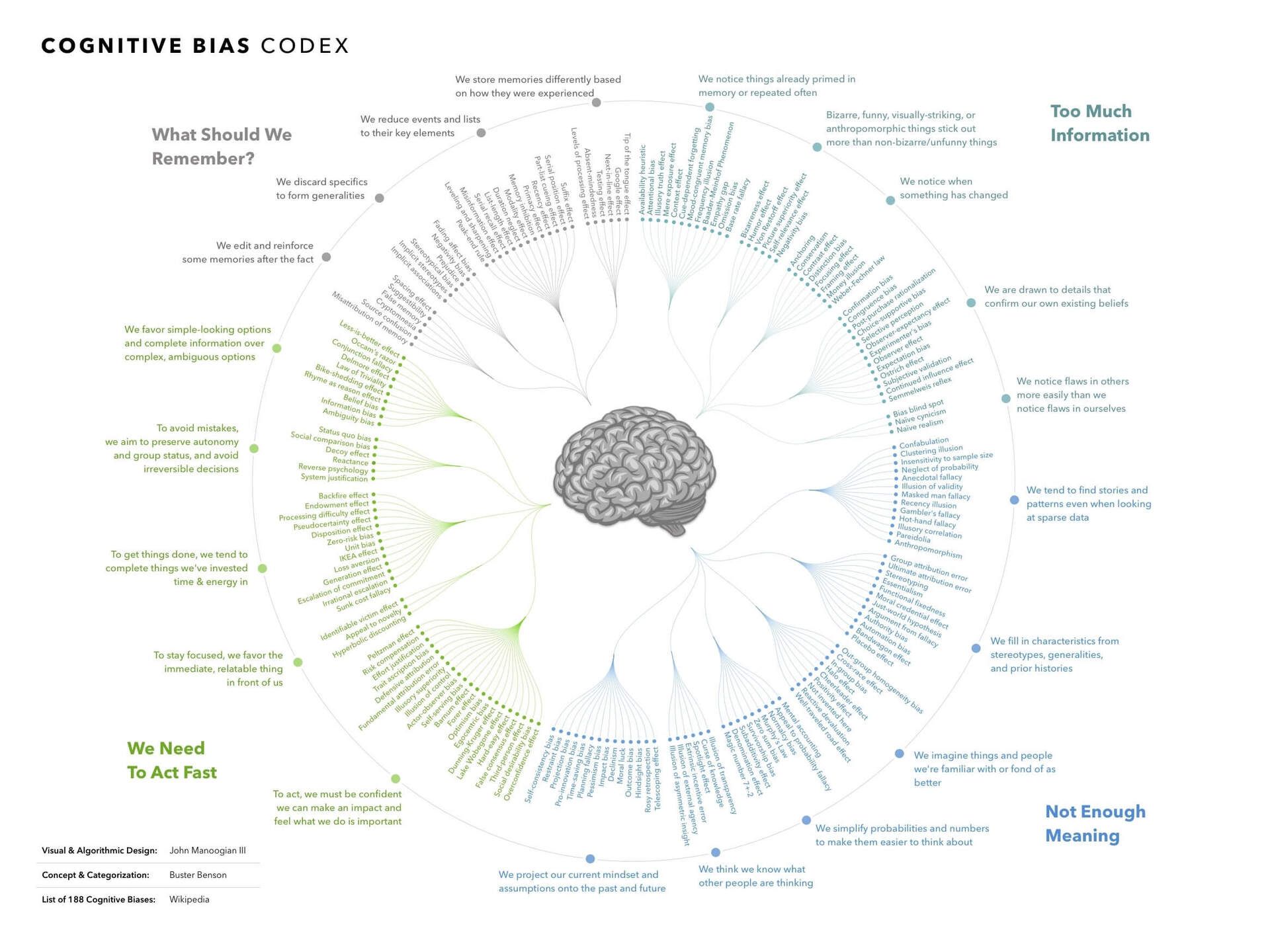

Wir Menschen möchten unsere Welt verstehen. Wenn wir das nicht tun, kann man versuchen diesem neuen, unerklärlichen Etwas auf den Grund zu gehen, indem man es genau untersucht – bis man es versteht. Aber das ist aufwendig, zeitintensiv und viele sind IMHO nicht dazu bereit, d.h. gehen den bequemen Weg und stützen sich auf Vorurteile. Und laut Wikipedia gibt es mindestens 188!

2. Gute Metapher, um KI-Intelligenz zu verstehen

Ethan Mollick ist einer der smartesten US-Professoren, der nicht KI oder Technik unterrichtet, sondern Business bzw. Economics. Darum hat er einen interessanten und praxisnahen Zugang zu KI, weil er es in seiner Forschung und im Unterricht für Bearbeitung echter Probleme nutzt.

Ich empfehle seinem Blog zu folgen und Buch “Co-Intelligence” zu lesen.

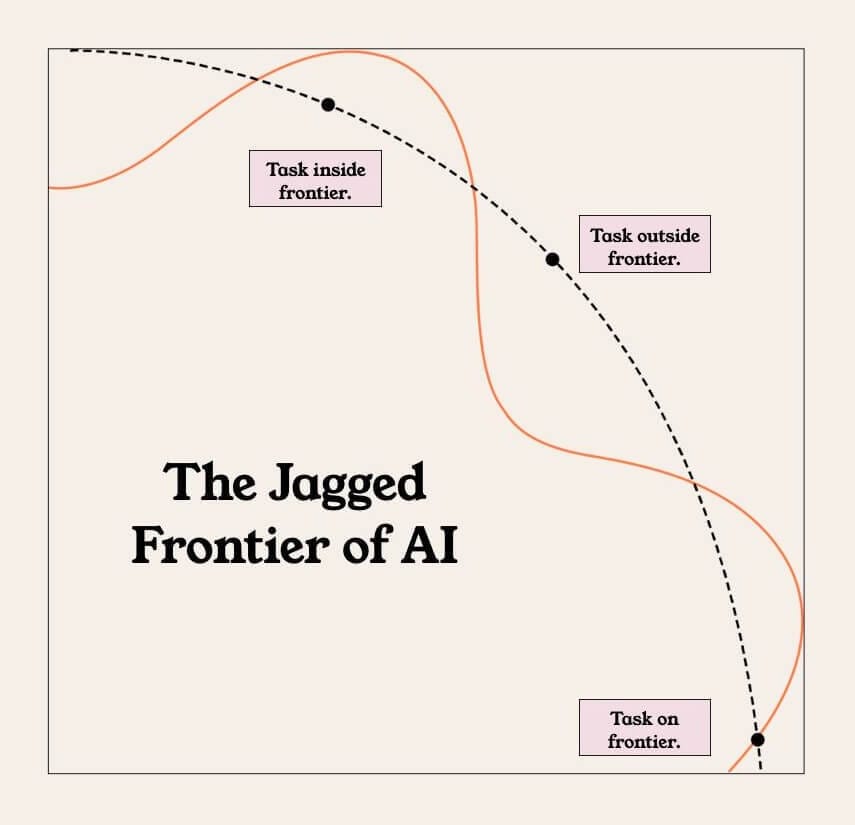

Er erfand Begriff “Jagged Frontier of AI” (deutsch: “zackige Grenze der KI”).

Dieser besagt, dass KI und Menschen nicht deckungsgleiche Befähigung haben, d.h. es gibt Aufgaben, die Menschen super leicht fallen, aber Maschinen immer noch Probleme haben – und umgekehrt.

2 Beispiele: Mensch vs. Maschine

Ein KI kann zwar ein grammatikalisch richtiges Gedicht schreiben, aber tut sich schwer, dass es auch wirklich emotional tiefgründig und bewegend/berührend ist. Das fällt jedem (halbwegs) eloquenten Mensch hingegen leicht.

Ein Mensch kann schnell Texte erfassen und aufschreiben, sollte er/sie bilingual sein, evtl. sogar relativ schnell übersetzen. Aber kaum ein Mensch kann einen Text lesen und dann auf Anhieb und schnell rückwärts aufschreiben. KI easy.

Smarte Evolution obiger Metapher

Dieses Bild zeigt einen Vorschlag, der Ethan Mollick’s Metapher “heraus gezoomt” visualisiert – und viele Profis gut, smart und zutreffend finden.

Der kleine Kreis symbolisiert, was wir Menschen können. Das unterscheidet sich natürlich auch von Mensch zu Mensch, aber vereinfacht betrachtet sollte das stimmen. Wobei es z.B. auch bei Männern und Frauen schon leichte Unterschiede im Skillset gibt, d.h. manches können tendenziell Männer besser, anderes sind Frauen überlegen.

Die Grafik zeigt von links nach rechts 5 Phasen, die einen Zeitverlauf darstellen, d.h. links die ersten KI-Modelle und rechts wie die Zukunft aussieht.

Die Lachs-Farbe symbolisiert den Umfang von KI’s Befähigung – von früher, über heute und in 2-3 Jahren. Dies zeigt auch gut, warum viele Menschen KI immer noch für “dumm” oder “unfähig” halten: diese Menschen fokussieren sich nur auf die Bereiche, wo KI versagt, und ignorieren, was KI alles schon kann – und viel besser!

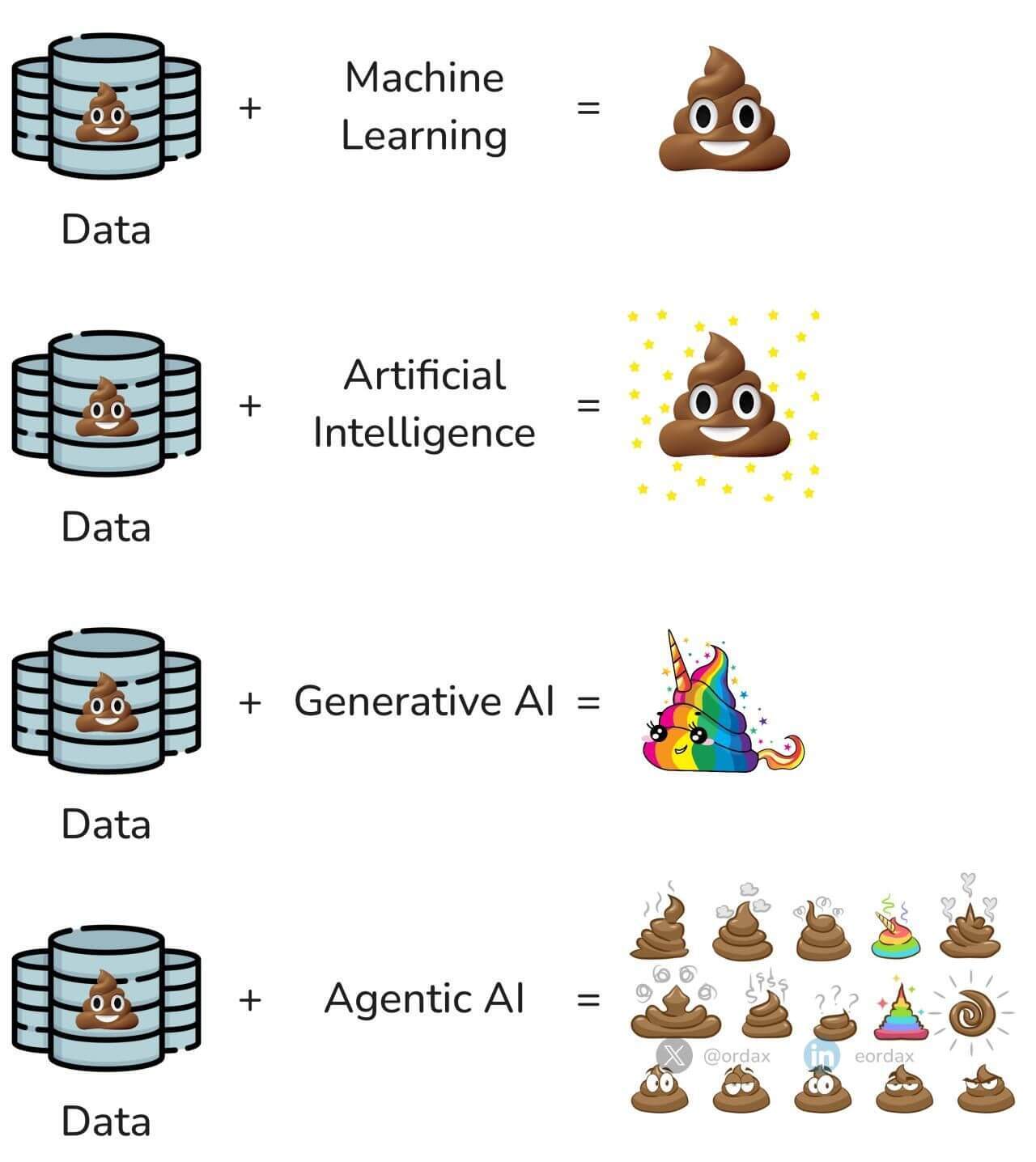

Zusätzlicher Fehler: Schlechte Daten

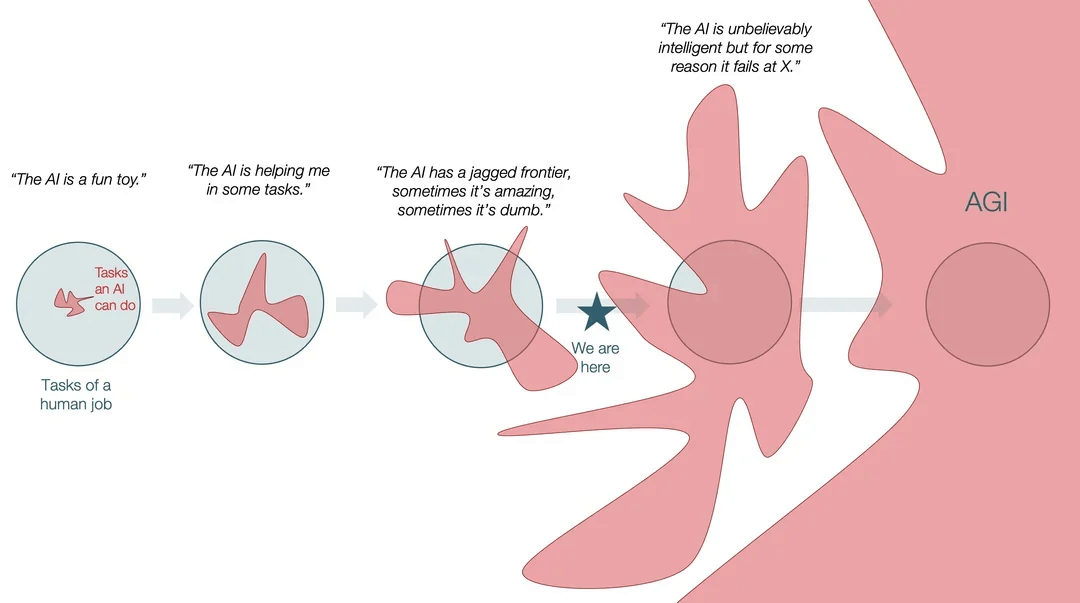

Würden Sie Ihrem Steuerberater, Arzt oder Elektroinstallateur falsche, zusammengeknüllte, verschmierte und unsinnige Informationen geben – und dann erwarten, dass er richtig und gut arbeiten kann?

NEIN! Aber die meisten Erwarten das bei KI. Warum?!

Obige Grafik ist von Eduardo Ordax und visualisiert das Problem sehr schön.

Vereinfacht zusammengefasst – man braucht 3 Dinge für KI-Arbeit:

Eine KI als "Denk-Motor” – z.B. LLM wie ChatGPT, Claude, Gemini, usw.

Einen guten Prompt, der genau sagt, was man will.

Eine gute Datenbasis mit allen für das jeweilige Projekt wichtigen Infos, die idealerweise in optimierter, maschinenlesbarer Form aufbereitet sind, z.B. XML, Markdown, JSON, TOON, o.ä.

Selbst wenn man sich bei 1. für ein führendes Modell entscheidet, scheitern viele am 2. Punkt (Prompten) und fast alle am 3. – der Datenbasis.

3. Wo sich Sam Altman, Elon Musk, Dario Armodei & alle Technik-Profis irren

Ich maße mir nicht an, dass ich besser in KI bin, als die genannten Chefs der KI-Firmen – aber ich habe dank meiner Werbeagentur-Laufbahn eine interessante Beobachtung gemacht. Diese ermöglicht mir eine wichtige Einordnung bzgl. der POV von Technik-Profis.

Ich habe seit 7. Lebensjahr (1984) mit Computern zu tun, d.h. seit IBM PC mit MS-DOS 3.0, CGA-Grafik, 5,25” Floppy – bzw. grauem 128K Apple Kasten-Mac.

Was mich Werbeagenturen über IT-Profis lehrte

Mein 1. Job war in Software-Firma, wo ich IT-Kaufmann (IHK) lernte, aber mich schnell langweilte, weil Kunden immer wieder dieselben basic Probleme hatten. Ich brauchte mehr Abwechslung und größere Herausforderungen. Darum wechselte ich die Branche und begann meine Werbeagentur-Laufbahn.

Dort freundete ich mich immer als 1. mit der IT-Abteilung an, weil ich deren Sprache verstand und die Nerds nicht so eingebildet bzw. abgehoben wie viele der Werber waren. Zudem fand ich’s erschreckend, wie undankbar und herablassend besonders die “Kreativen” ihren IT-Kollegen gegenüber waren. Die meisten wüssten ohne IT nichtmal wie sie ein E-Mail-Programm konfigurieren müssten. Während die IT in meinen Augen immer das Rückgrat jeder Firma ist/war – ohne die/das nix ginge.

Was mich noch mehr faszinierte: selbst die schlauesten IT-Profis in den besten Agenturen, verstanden nicht die Basics vom Marketing-Job und besonders nicht was Werbe-Kreativen den ganzen Tag machen! Ich sprach mit smarten Programmierern und Systemadministratoren, die teilweise 15 Jahre oder länger in Werbeagenturen arbeiteten, aber null Ahnung vom Tagesgeschäft hatten!

Darum glaube ich nicht, dass KI-CEOs richtig liegen

Was Technik-Profis bei der KI-Vollautomatisierung vergessen: wie wichtig und bedeutsam u.a. Kreativität und Emotionen sind. Oder wie unglaublich irrational viele Menschen denken und agieren!

Darum empfehle ich in meinen KI-Workshops, dass man mindestens einen und besser mehrerer der obigen 6 menschlichen Kompetenzbereiche für sich entdeckt und als Fähigkeit übt, bzw. verbessert.

Ich bin fest davon überzeugt, dass diese 6 Bereiche noch Jahrzehnte von geübten Menschen besser beherrscht werden, als von den besten KIs der Welt.

Oben Link zu einem halbstündigen Podcast, der das auf Englisch detailliert erklärt. Wer nicht gut Englisch kann: einfach Untertitel aktivieren, weil YouTube diese automatisch für dutzende Sprachen übersetzt.

4. Das ist der Stand der KI-Technik

Ich hätte hier easy 100-200 Charts mit KI-Diagrammen einfügen können, aber “ain’t no bogy got time for that” und zudem langweilig, weil die alle nur eine Richtung zeigen: exponentiell nach oben! AUSNAHMSLOS!

Es folgen ein paar Charts, die nicht exponentiell hoch gehen. Diese haben alle eine logarithmische Y-Achse!

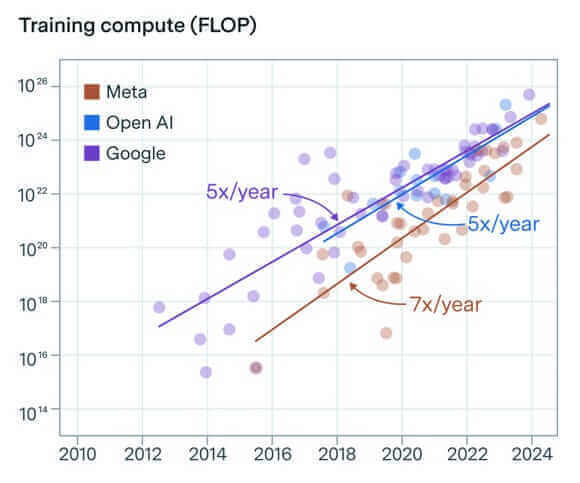

Das obige Diagramm zeigt, wie schnell die Rechenleistung von 3 der bekanntesten Tech-Firmen zunimmt.

Rechenpower wird u.a. in FLOPS gemessen, d.h.: Wie viele Gleitkomma-Zahlen kann ein System pro Sekunde berechnen?

Eine Gleitkomma-Zahl mit einfacher Genauigkeit ist eine Zahl mit 31 Nachkommastellen, z.B. 1,123456789012345678901234567890.

Da NVIDIA Weltmarkt-Führer bei GPU-KI-Chips ist, hat sich als “defacto” Standard die halbe Genauigkeit (Zahl mit 16 Stellen) durchgesetzt, weil deren Chip H100 als Rechenmaßstab genommen wird.

Allein Google’s Computer können 2.400 ExaFLOPS rechnen:

2.400 × 10.000.000.000.000.000.000 x 16-stellige Zahlen multiplizieren!

PRO! SEKUNDE!

Das ist nur eine von immer mehr Firmen weltweit, die das können.

Wenn man bedenkt, dass jede der “Magnificent 7” US-Firmen (= Google, Meta, Amazon, etc) für KI in 2026 mehr Budget investiert (z.B. allein Meta 600 Milliarden) als ganz Deutschland für Bundeshaushalt hat (und sich dafür noch verschulden, bzw. Kredite aufnehmen muss), dann wird einem klar, wie weit wir hinten liegen.

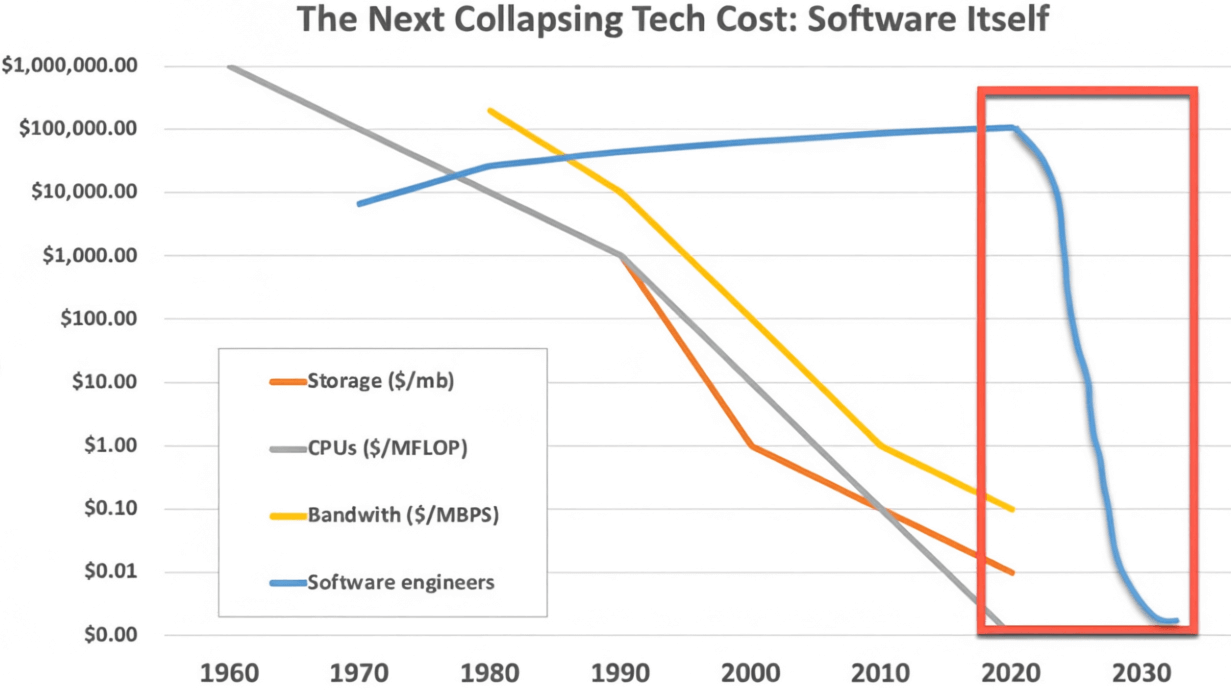

KI wird unaufhörlich besser – und dabei 90% günstiger jedes Jahr!

Effizienzsteigerung ist nichts neues, weil das auch bei früheren Techniken und deren Infrastrukturen passierte, aber das Tempo ist unerreicht.

Die Software-Industrie erleidet gerade das Schicksal der Musikindustrie, als Napster, Pirate Bay, Peer2Peer-Sharing, Streaming-Dienste, usw. aufkamen.

Das Tempo der KI-Branche spiegelt sich auch im Umsatzwachstum wieder, das exponentiell ist – und schneller als alles zuvor dagewesene. Sogar schneller als die Hyperscaler Amazon, MS Azure und Google Cloud.

Aber warum leidet KI-Branche nicht wie Musik-Industrie?

Ganz einfach, weil KI mehr als Software ist: KI ist probabalistische Intelligenz.

KI-Firmen verdienen ihr Geld damit, dass sie Arbeitsplätze ersetzen, die früher Praktikanten und Junioren ausgeführt hätten. Darum kollabiert gerade der Jobmarkt für Berufseinsteiger – selbst jene von Elite-Unis wie z.B. Harvard.

Großes Problem ist auch, dass die meisten CEOs nur kurzfristig denken, d.h. wie erhöhe ich ROI fürs nächste Quartal? Mit KI! Weil ich damit effizienter bin!

Das ist einerseits richtig, aber was viele CEOs vergessen:

Der Anspruch ihrer Zielgruppen/Kunden steigt rasant, d.h. diese erwarten immer mehr von Marke, Produkt, Service, Marketing, UX, usw. Das ist IMHO der aktuell bei meisten Firmen vernachlässigte Bereich.

Wenn man keine Praktikanten und Junioren einstellt, dann kappt man die Talent-Pipeline, d.h. keine HR zum Nachrücken, sobald ältere MA in den Ruhestand gehen.

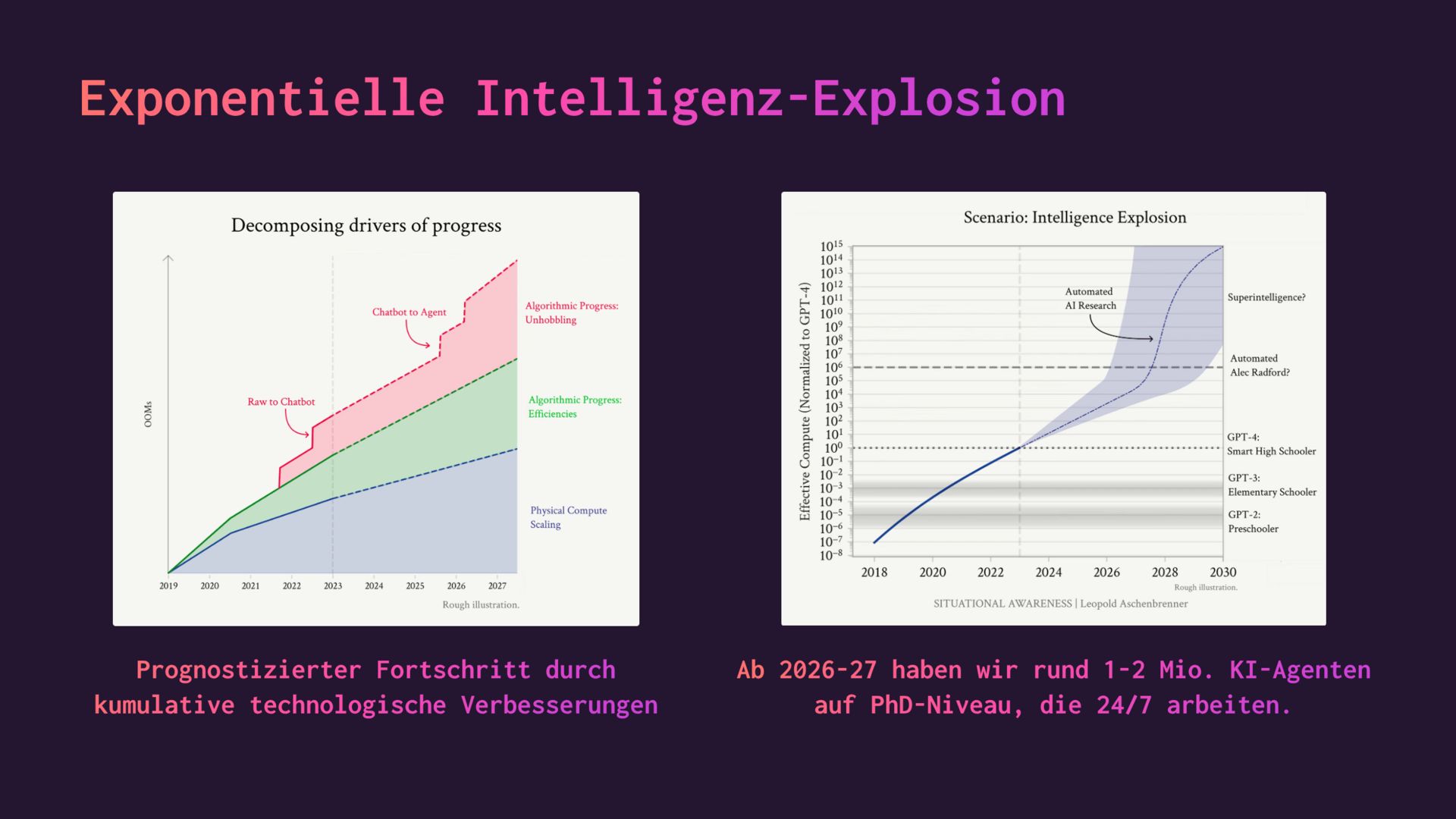

Links: vereinfacht, wie einzelne Technik-Bestandteile zunehmen und aggregiert das Gesamttempo des Fortschritts erhöhen.

Rechts: wie KI-Firmen die Zukunft planen, d.h. Rechenpowerzuwachs pro Jahr.

Beide Diagramme haben logarithmische Y-Achse und fast alle KI-Experten gehen davon aus, sobald LLMs so smart wie menschliche Wissenschaftler sind, übernehmen sie große Teile der Forschung, was das exponentielle Wachstum noch exponentieller macht. (Keine Ahnung, wie man das Superlativ davon bildet.)

Man spricht auch von “Intelligenz-Explosion”.

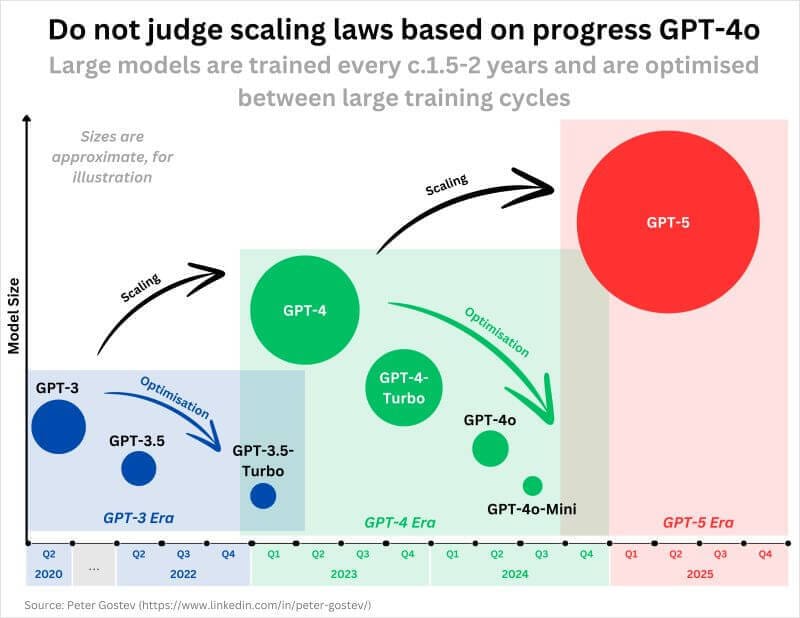

Einer der größten KI-Durchbrüche in 2024 war die Entdeckung eines neuen Skalierungsgesetzes. Diese besagen, dass je mehr ein gewisser Parameter zunimmt, desto “schlauer” wird KI. seit ca. 2017 wusste man:

Pre-Training Scaling: Je größer das neuronale Netz, desto smarter das LLM.

Problem: Zur Verdopplung des “KI-IQ” muss man das NN vervierfachen.

Ergo: das wird sehr schnell, sehr teuer!Post-Taining Scaling: Je mehr Daten man hat, um LLM zu trainieren, desto smarter wird es.

Problem: Inzwischen ist das ganze Internet abgegrast und fast alle Hersteller haben alle Daten, d.h. niemand mehr Wettbewerbsvorteil.

Lösung: Neue Datenquellen finden, z.B. Filmbibliotheken, Firmeninterna, usw.Test-Time Scaling: Dieses Gesetz wurde 2024 gefunden. Es besagt, dass je länger ein LLM über einen Prompt “nachdenkt”, desto besser wird der Output.

Problem: Je länger eine KI arbeitet, desto mehr Strom verbraucht sie und desto teurer wird die Lösung der Aufgabe.

IMHO gibt es ein 4. Gesetz, das aktuell übersehen wird, aber das würde in diesem Newsletter zu weit führen. Zudem glaube ich, dass weitere Skalierungsgesetze aufkommen, sobald es die ersten funktionierenden Welt-Modelle gibt.

Man sieht das u.a. an “Emerging Properties” aka “Aufkommenden Eigenschaften” mit denen nichtmal Wissenschaftler gerechnet haben, z.B. das man ein Bild nehmen kann, darin rein malt wie man ein Video gern hätte und dann eine Video-KI daraus einen Film erstellt. Oder was inzwischen mit Nano Banana’s Bild-KI machbar ist.

KIs werden nicht nur smarter, sondern auch immer selbstständiger, d.h. können immer längere und komplexere Aufgaben ausführen – ohne menschliche Hilfe!

Aktuelle Programmier-Tools können 1-2 Stunden allein arbeiten. Anthropic schaffte es sogar, dass Ihre Claude-KI in 30 Stunden über 11.000 Zeilen schrieb, um einen Slack-Clone zu erstellen, der sogar im Test hinterher funktionierte!

Zudem werden KI auch immer effizienter, d.h. können mit kleineren Modellen größere Rechenpower bieten. KI-Labore bauen erst ein neues Modell und schrumpfen es hinterher iterativ, indem sie Algorithmen, Architektur, uvm. optimieren.

5. Was bedeutet das für uns alle?

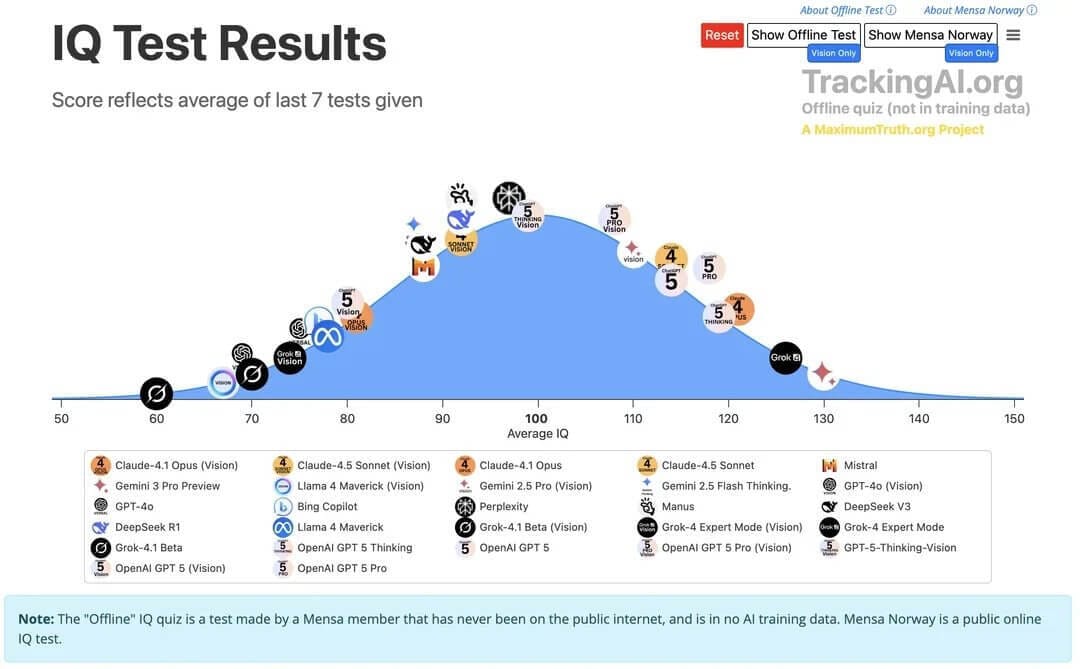

KI wird immer schlauer und viele Modelle übertreffen den menschlichen Durchschnitts-IQ schon heute.

KI ist bald selbst den schlausten Menschen der Welt in allen logischen und faktenbasierten Tätigkeiten überlegen.

Selbst wenn wir neue Tests erfinden, die so konzipiert sind, dass sie KI schwer fallen (sollten) – wie BBH & ARC-AGI, meistert KI alle in Rekordzeit. (100 = Median-Mensch)

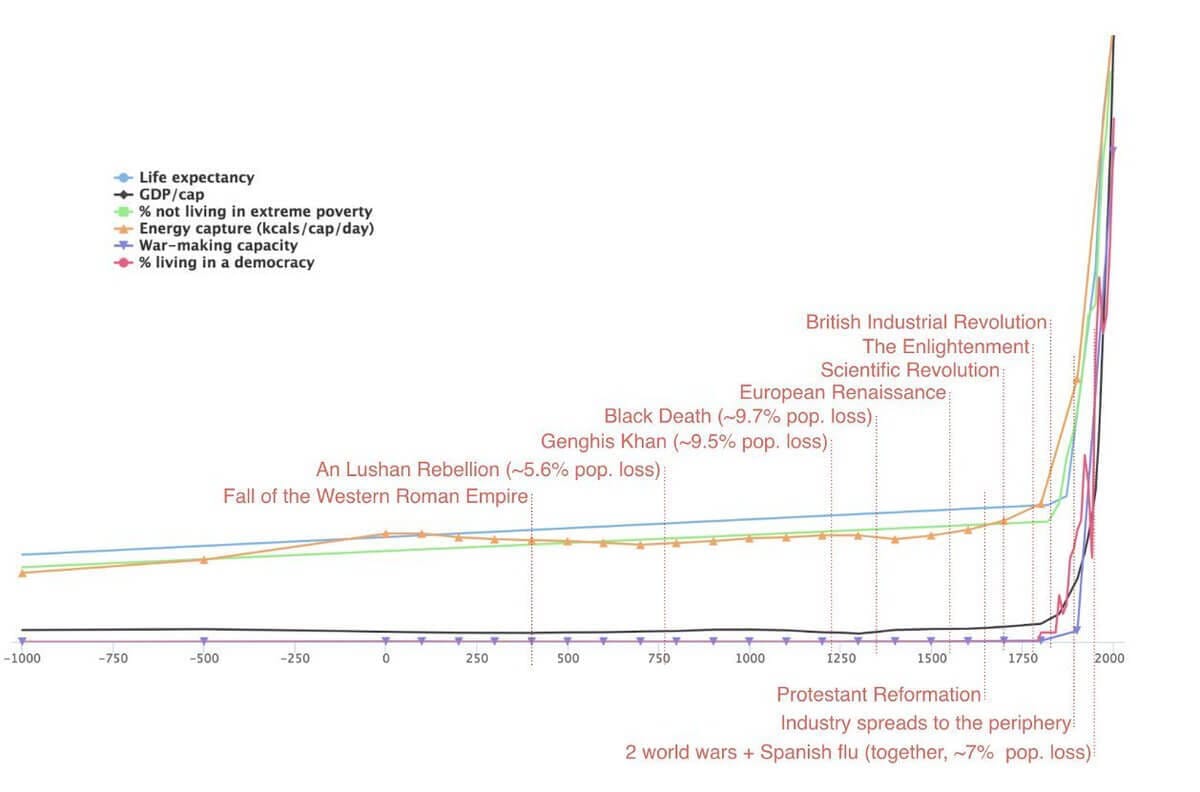

Ein nüchterner Blick auf unsere Entwicklung reicht. Allein in den letzten 100 Jahren haben wir durchschnittliche Lebenserwartung verdoppelt! Zudem stieg Wirtschaftsertrag, Energie-Gewinnung (und -Verbrauch), uvm.

Fazit: Wir stehen hier und der Knick passiert vor 2030!

6. Meine Take-Aways für unsere Zukunft

🕊️ Das Tauben-Paradoxon (Unerklärbarkeit)

Da maschinelle Intelligenz menschliche kognitive Horizonte sehr bald weit überschreitet, wird ihre Logik und Argumentation für uns unerklärbar werden.

Die Analogie: Man kann einer Taube nicht die Regeln von Schach beibringen. Ihr fehlt die kognitive Hardware für die Abstraktion von "Spiel" oder "Gewinnen".

Die Realität: KI wird Probleme mittels Intuitionen (Hyperobjekten) lösen, für die Menschen die neuronale Hardware fehlt. Wir werden die Tauben sein, die auf das Schachbrett starren.

✅ Der große Gleichmacher: Geteilte Realität

Trotz des "Tauben-Paradoxons" bleiben wir Menschen die ultimativen Bewerter, da sowohl Mensch als auch Maschine in der physikalischen Realität existieren.

Verifizierung vor Verständnis: Wir verstehen vielleicht nicht, wie die KI einen Warp-Antrieb oder ein Krebsmedikament entwickelt hat, aber wir können verifizieren, dass es funktioniert.

Ground Truth: Wenn die "magische" Intuition einer KI keine messbaren Ergebnisse in Materie und Energie (Physik) liefert, ist es eine Halluzination. Die Realität ist der Test.

⚡ Handlungsempfehlungen

Schluss mit Definitionsdebatten: Beenden wir semantische Diskussionen über "was ist AGI" oder "ist es empfindungsfähig". Fokussieren wir uns auf die Fähigkeitscharakterisierung: Was kann die Maschine physikalisch tun, was ein Mensch nicht kann?

Akzeptieren wir Unerklärbarkeit: Wir sollten bei fortgeschrittenen Aufgaben nicht erwarten, dass KI "interpretierbar" oder menschlich "erklärbar" bleibt/ist. Bereiten wir uns (emotional & organisatorisch) auf "Black Box"-Lösungen vor, die durch empirische Ergebnisse statt logische Erklärungen validiert werden.

Fokus auf "Hyperobjekte": Nutzen wir KI fürs Management komplexer Systeme (Genome, globale Logistik, Klima), die zu groß für unser menschliches Arbeitsgedächtnis sind. Hier ist der Vorteil des "kognitiven Horizonts" der KI am größten.

Achten wir auf die thermodynamische Decke: Wir sollten in Wirtschaft und Technik Bereiche identifizieren, in denen mehr "Intelligenz" aufgrund von Rauschen oder Chaos keinen Mehrwert schafft. Wechseln wir in diesen Bereichen zur Effizienzsteigerung (und somit Kostenreduktion). Aber bis dahin ist es noch ein weiter Weg.

Vertrauen, aber verifizieren (physikalisch): Wir sollten eine wissenschaftliche Haltung einnehmen. Wir sollten KI-Lösungen als valide Hypothesen akzeptieren, sobald wir selber oder von KI physikalische Beweise (Labortests, Prototypen) erhalten.

Frohe Weihnacht!

Ich hoffe, dass hilft zur Einordnung, wo wir stehen und unsere Reise hingeht?

Sicher super Gesprächsstoff für die ganze Familie unterm Weihnachtsbaum 😉

Dir gefällt mein Newsletter?

Danke. Freut mich, wenn du Freude daran hast.

Ich freue mich über jede Art der Unterstützung:

Teilen diesen Newsletter mit Freunden, Bekannten und Lernwilligen, damit Sie nicht vom Tempo der KI-Transformation abgehängt werden.

Folge mir auf deinen bevorzugten Social Media Plattformen, wo ich nur über KI, Technologien, Kreativität, Strategien und Fortbildung poste.